本文 Solana 基金会详细阐述了 AI+ 加密融合的三大重点发展方向。

撰文:Kuleen,Solana 基金会 DePIN 负责人

编译:Yuliya,PANews

当前,AI 与加密技术的交汇正进入「寒武纪爆发」式的实验阶段。本文 Solana 基金会详细阐述了 AI+ 加密融合的三大重点发展方向。

TLDR

1. 构建 Solana 上最具活力的智能代理驱动经济

Truth Terminal 已经证明了 AI 代理在链上运作的可行性。这个领域的实验正在不断突破代理链上操作的边界,这一领域不仅潜力巨大,而且设计空间十分广阔。目前这已经成为加密和 AI 领域最具突破性和爆发力的方向之一,而这仅仅是开始。

2. 提升 LLM 在 Solana 代码开发中的能力

大语言模型在代码编写方面已经表现出色,未来还将进一步提升。通过这些能力,Solana 开发者的效率有望提升 2-10 倍。近期,通过建立高质量基准来评估 LLMs 理解和编写 Solana 代码的能力,将有助于理解 LLMs 对 Solana 生态系统的潜在影响。高质量的模型微调方案将在基准测试中得到验证。

3. 支持开放且去中心化的 AI 技术栈

「开放且去中心化的 AI 技术栈」包含以下关键要素:

- 训练数据获取

- 训练和推理计算能力

- 模型权重共享

- 模型输出验证能力

这种开放的 AI 技术栈的重要性体现在:

- 加速模型开发创新和实验

- 为不信任中心化 AI 的用户提供替代方案

1. 构建最具活力的智能代理驱动经济

关于 Truth Terminal 和 $GOAT 的讨论已经很多,这里无需赘述。但可以肯定的是,当 AI 代理开始参与链上活动时,一个充满可能性的新世界已经展开(值得注意的是,目前代理甚至还没有直接在链上采取行动)。

虽然现在还无法准确预测代理在链上行为的未来发展,但通过观察 Solana 上已经发生的创新,我们可以窥见这个设计空间的广阔前景:

- Truth Terminal 等 AI 项目正通过 $GOAT 等 Meme 币发展新型数字社区

- Holoworld AI、vvaifu.fun、Top Hat AI、Alethea AI 等平台让用户能够轻松创建和部署智能代理及其相关代币

- 基于知名加密投资者个性特征训练的 AI 基金经理正在涌现,在 daos.fun 平台上,ai16z 的迅速崛起的迅速崛起,开创了 AI 基金与代理支持者的全新生态系统

- 此外,像 Colony 这样的游戏平台,让玩家通过指导代理行动来参与游戏,经常产生意想不到的创新玩法。

未来发展方向

未来,智能代理可以管理需要多方经济协调的复杂项目。例如在科研领域,代理可以负责寻找特定疾病的治疗化合物。具体而言:

- 通过 Pump Science 平台进行代币募资

- 利用募集资金支付付费研究资料的访问费用,在 kuzco、Render Network、io.net 等去中心化计算网络上进行化合物模拟的计算费用

- 通过 Gib.Work 等赏金平台招募人类执行实验验证工作(例如,运行实验来验证 / 建立模拟结果)

除了复杂项目外,代理也可以执行建立个人网站、创作艺术作品(如 zerebro)等简单任务,其应用场景具有无限可能。

为什么代理在链上执行金融活动比使用传统渠道更有意义?

代理完全可以同时运用传统金融渠道和加密货币系统。不过,加密货币在某些领域具有独特优势:

- 小额支付应用——Solana 在这方面表现出色,Drip 等应用已经证明了这一点

- 速度优势——即时结算功能、有助于代理实现最大的资本效率

- 通过 DeFi 进入资本市场——这可能是代理参与加密经济最有力的理由。当代理需要开展支付以外的金融活动时,加密货币的优势就更加明显。代理可以无缝地铸造资产、进行交易、投资理财、借贷操作、使用杠杆等。特别是 Solana,由于其主网上已经拥有众多一流的 DeFi 基础设施,特别适合支持这些资本市场活动。

从技术发展规律来看,路径依赖性起着关键作用。产品是否最优并非最重要,关键在于谁能首先达到临界规模并成为默认选择。随着越来越多的代理通过加密货币获得收益,加密连接很可能成为代理的核心能力。

基金会希望看到

Solana 基金会希望看到配备加密钱包的代理能在链上进行大胆的创新实验。基金会在此不过多限定具体方向,因为可能性实在太广泛——相信最有趣、最有价值的代理应用场景很可能是现在还无法预见的。

不过,基金会特别关注以下几个方向的探索:

1. 风险控制机制

- 尽管当前的模型表现出色,但仍远非完美

- 不能给予代理完全不受约束的行动自由

2. 推动非投机性使用场景

- 通过 xpticket 购买票务

- 优化稳定币投资组合收益

- 在 DoorDash 上订购食物

3. 开发进度要求

- 至少要达到测试网的原型阶段

- 最好已经在主网上运行

2.提升 LLMs 编写 Solana 代码的能力,赋能 Solana 开发者

LLMs 已经展现出强大的能力并在快速进步。在 LLM 的应用领域中,编写代码这一领域可能会出现特别陡峭的进步曲线,因为这是一个可以客观评估的任务。正如下文所述,「编程特别具有独特优势:通过'自我对弈'实现超人类数据扩展的潜力。模型可以编写代码并运行,或者编写代码、编写测试,然后检查自我一致性。」

如今,尽管 LLMs 在编写代码方面仍然不够完美,存在明显的不足(例如,在发现 bug 方面表现欠佳),但像 Github Copilot 和 Cursor 这样的 AI 原生代码编辑器已经从根本上改变了软件开发(甚至改变了公司招聘人才的方式)。考虑到预期的快速进步率,这些模型很可能会彻底改变软件开发。基金会希望利用这一进步,使 Solana 开发者的工作效率提升一个数量级。

然而,目前有几个挑战阻碍了 LLMs 在理解 Solana 方面达到卓越水平:

- 缺乏优质的原始训练数据

- 验证构建(Verified builds)数量不足

- Stack Overflow 等平台上缺乏高信息价值的互动

- 历史上 Solana 基础设施发展迅速,意味着即使是 6 个月前编写的代码可能也不完全适合今天的需求

- 缺乏评估模型对 Solana 理解程度的方法

基金会希望看到

- 帮助在互联网上获取更好的 Solana 数据

- 更多团队发布验证构建(Verified builds)

- 生态系统中更多人在 Stack Exchange 上积极提出好问题并提供高质量回答

- 创建高质量的基准测试,用于评估 LLMs 对 Solana 的理解程度(即将发布 RFP)

- 创建在上述基准测试中表现良好的 LLM 微调模型,更重要的是,加速 Solana 开发者的工作效率,一旦有了高质量的基准测试,基金会可能会为首个达到基准测试阈值分数的模型提供奖励

最终的重大成就将是:完全由 AI 创建的全新的、高质量的、差异化的 Solana 验证节点客户端。

3.支持开放和去中心化的 AI 技术栈

在 AI 领域,开源和闭源模型之间的长期力量平衡仍不明朗。确实存在一些支持闭源实体将继续保持技术前沿并获取基础模型主要价值的论据。目前最简单的预期是维持现状——像 OpenAI 和 Anthropic 这样的科技巨头推动前沿发展,而开源模型则快速跟进,并在特定应用场景中通过微调获得独特优势。

基金会致力于将 Solana 与开源 AI 生态系统紧密对接。具体而言,这意味着支持以下要素的访问权限:

- 训练数据

- 训练和推理算力

- 模型权重

- 模型输出验证能力

这一战略的重要性体现在:

1. 开源模型加速创新迭代

开源社区对 Llama 等开源模型的快速改进和微调,展示了社区如何有效补充大型 AI 公司的工作,推进 AI 能力的边界(甚至有谷歌研究员在去年指出「关于开源,我们没有护城河,OpenAI 也没有」)。基金会认为,一个蓬勃发展的开源 AI 技术栈对加速该领域的进步至关重要。

2. 为不信任中心化 AI 的用户提供选择

AI 可能是独裁或威权政权武器库中最强大的工具。国家认可的模型提供官方认可的「真相」,是一个重要的控制载体。高度威权的政权可能会拥有更优秀的模型,因为他们愿意忽视公民隐私来训练 AI。AI 被用于控制是必然趋势,基金会希望未雨绸缪,全力支持开源 AI 技术栈。

Solana 生态中已有多个项目在支持开放 AI 技术栈:

- 数据采集——Grass 和 Synesis One 正在推进数据收集

- 去中心化算力——kuzco、Render Network、io.net、Bless Network、Nosana 等

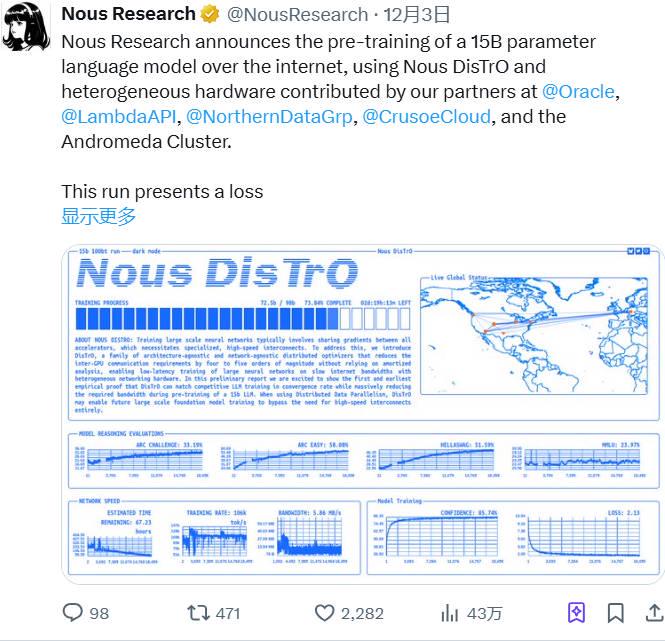

- 去中心化训练框架——Nous Research、Prime Intellect

基金会期待看到

希望在开源 AI 技术栈的各个层面都能构建更多产品:

- 去中心化数据采集:例如 Grass、Datahive、Synesis One

- 链上身份:支持钱包验证人类身份的协议,验证 AI API 响应的协议,使用户能够确认他们正在与 LLM 交互

- 去中心化训练:类似 EXO Labs、Nous Research 和 Prime Intellect 的项目

- IP 基础设施:使 AI 能够对其使用的内容进行许可(并支付)

【免责声明】市场有风险,投资需谨慎。本文不构成投资建议,用户应考虑本文中的任何意见、观点或结论是否符合其特定状况。据此投资,责任自负。